Le 21 avril 2026, OpenAI a publié gpt-image-2, son nouveau modèle de génération d'image. En moins de 12 heures, le modèle a pris la première place d'Image Arena avec une avance de 242 points sur ses concurrents, un écart rarement observé sur ce classement. Mais la vraie rupture n'est pas dans le score : gpt-image-2 est le premier modèle image d'OpenAI à intégrer une phase de reasoning native avant de dessiner, à générer du texte lisible en cinq langues non latines, et à pouvoir faire une recherche web pour documenter ses visuels. Pour les PME et ETI françaises qui utilisent déjà la génération d'image IA dans leur marketing, leur e-commerce ou leur communication, cette sortie change concrètement ce qu'il est possible d'automatiser. Voici ce qu'il faut retenir.

Ce que change gpt-image-2 par rapport à DALL-E 3

gpt-image-2 n'est pas une simple mise à jour incrémentale de DALL-E. OpenAI parle d'un saut de qualité comparable à celui marqué par GPT-4 sur le texte en 2023. Trois changements techniques justifient cette comparaison.

Une phase de "thinking" avant la génération

C'est la nouveauté la plus importante. Avant de produire une image, gpt-image-2 déroule une phase de raisonnement explicite, exactement comme le font les modèles textuels de type o1 ou Claude avec extended thinking. Le modèle décompose la demande, vérifie la cohérence interne du prompt, anticipe les pièges (proportions, ombres, perspective, texte à insérer) et construit un plan de composition avant de rendre le pixel.

En pratique, cela se traduit par une chute spectaculaire des artefacts classiques : doigts en trop, objets qui flottent, reflets incohérents, perspectives cassées. Les premiers retours publiés par The New Stack indiquent une réduction de plus de 60 % des défauts visibles sur un même benchmark de prompts complexes, par rapport à DALL-E 3.

2K natif et ratios de 3:1 à 1:3

Le modèle génère en 2K sans upscaling et couvre une plage de ratios très large, du panoramique 3:1 au portrait extrême 1:3. Pour une entreprise, cela veut dire qu'un même prompt peut produire le visuel principal d'un article de blog, la miniature LinkedIn carrée et la story Instagram verticale, sans retouche ni recadrage manuel.

Jusqu'à 8 images cohérentes avec continuité de personnage

gpt-image-2 peut générer des séries de jusqu'à 8 images en maintenant la cohérence d'un personnage, d'un produit ou d'un décor. C'est la fonctionnalité que cherchaient les équipes marketing depuis deux ans : pouvoir raconter une histoire visuelle avec le même protagoniste, sans passer par un workflow ComfyUI complexe ou un modèle spécialisé type LoRA.

Pour un e-commerce, cela signifie une fiche produit cohérente avec sept ambiances différentes. Pour une agence, une campagne avec un personnage fictif décliné sur huit supports.

Le texte dans l'image, la vraie rupture

Si le benchmarking est impressionnant, le changement qui aura le plus d'impact opérationnel concerne le rendu du texte.

Exemple officiel OpenAI : menu "La Cantina" généré par gpt-image-2. Prix, descriptions, hiérarchie typographique : tout est rendu sans glitch, là où DALL-E 3 échouait systématiquement. Source : OpenAI, via TechCrunch.

Exemple officiel OpenAI : menu "La Cantina" généré par gpt-image-2. Prix, descriptions, hiérarchie typographique : tout est rendu sans glitch, là où DALL-E 3 échouait systématiquement. Source : OpenAI, via TechCrunch.

Japonais, coréen, chinois, hindi, bengali

gpt-image-2 est le premier modèle OpenAI capable de rendre du texte dense et lisible dans cinq langues à alphabets non latins. Les caractères japonais, coréens, chinois, hindi et bengali sortent corrects, avec une typographie cohérente et sans les glitches habituels. C'est un point que TechCrunch souligne particulièrement dans sa couverture du 21 avril.

Pour une PME française qui vend à l'export ou qui communique sur des marchés asiatiques, la donne change. Jusqu'ici, un visuel multilingue impliquait soit un graphiste natif, soit un workflow en deux temps avec superposition de texte en post-production. Désormais, un prompt suffit.

Recherche web avant de dessiner

gpt-image-2 est aussi le premier modèle image grand public à pouvoir déclencher une recherche web pendant sa phase de thinking. Concrètement, si vous lui demandez "une infographie sur les chiffres du e-commerce français en 2026", il va chercher les statistiques à jour avant de composer le visuel, plutôt que d'inventer des chiffres plausibles mais faux. C'est un pas énorme vers la fiabilité éditoriale des visuels générés.

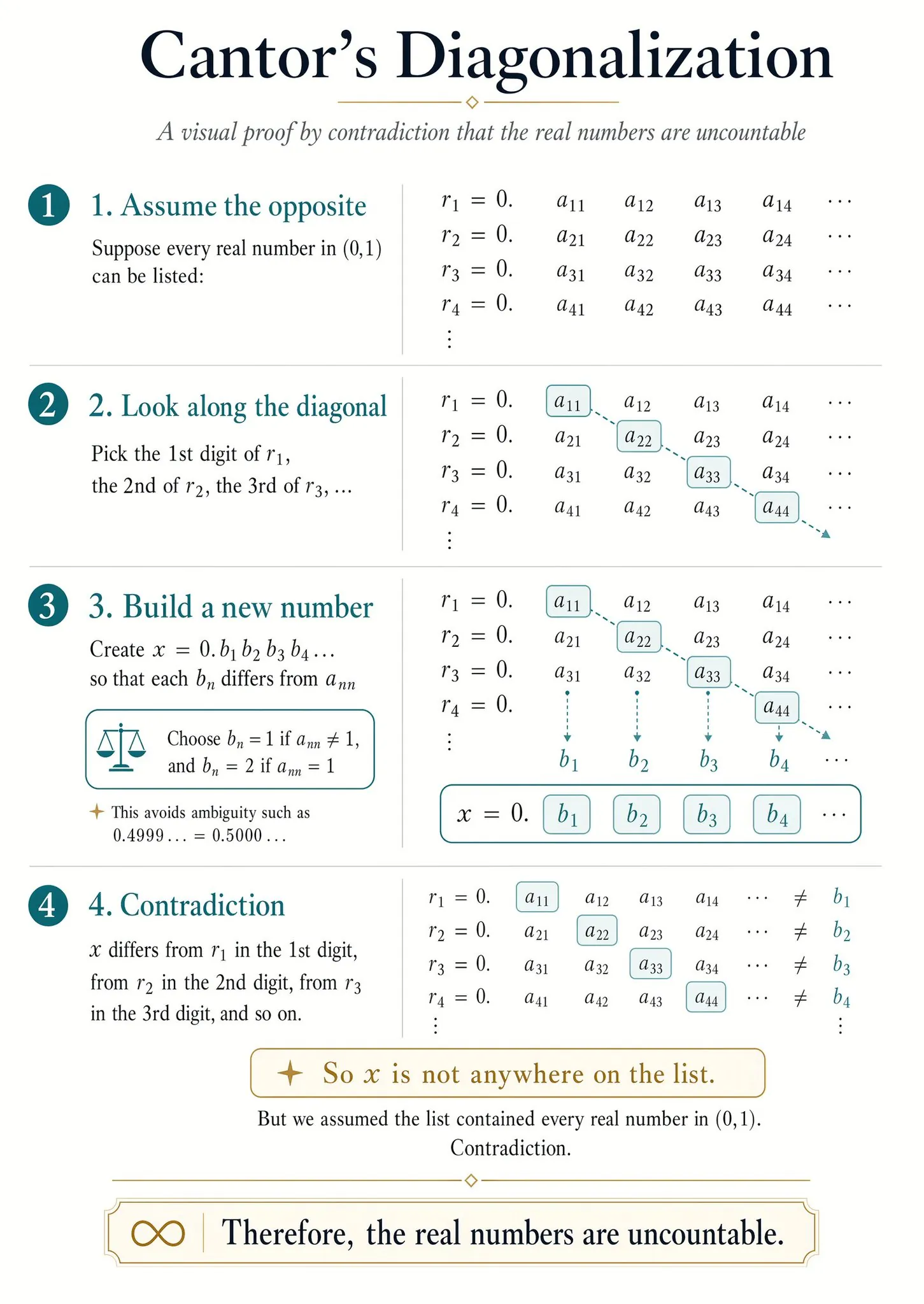

Infographie "Cantor's Diagonalization" produite par gpt-image-2 : notation mathématique, layout éditorial multicolonne, hiérarchie typographique. Le type de visuel qui demandait jusqu'ici un graphiste expert. Source : OpenAI.

Infographie "Cantor's Diagonalization" produite par gpt-image-2 : notation mathématique, layout éditorial multicolonne, hiérarchie typographique. Le type de visuel qui demandait jusqu'ici un graphiste expert. Source : OpenAI.

Comparé à d'autres sorties récentes comme Gemma 4 de Google ou Muse Spark de Meta, gpt-image-2 se distingue clairement par cette capacité de reasoning + recherche sur le domaine visuel.

Cas d'usage concrets pour les PME et ETI françaises

Voyons comment gpt-image-2 peut se traduire en gains opérationnels sur trois fonctions clés.

Marketing et réseaux sociaux

La génération d'image IA était déjà utilisée pour les posts LinkedIn et les bannières blog. Avec gpt-image-2, les équipes marketing peuvent désormais produire une campagne cohérente de 8 visuels (personnage fictif, ambiance uniforme, messages différents) en quelques minutes. Le coût par visuel descend sous la barre des 0,05 euro par image, contre 50 à 150 euros pour une retouche graphiste.

E-commerce et fiches produit

Pour un catalogue e-commerce, le problème historique est la mise en scène : un produit photographié sur fond blanc reste plat. gpt-image-2 permet de générer, à partir d'une photo produit de référence, une série de visuels en contexte (cuisine, extérieur, ambiance lifestyle) tout en gardant le produit strictement identique. Notre expérience chez RedArrow sur des projets similaires montre un gain de 30 à 40 % de conversion sur les fiches enrichies.

Communication interne et supports RH

Les supports de formation, les newsletters internes, les communications DRH consomment énormément de visuels. gpt-image-2, avec son rendu texte multilingue et sa capacité à produire des infographies factuellement correctes, devient un outil de production industrielle pour les équipes com'. Le budget d'illustration d'une newsletter mensuelle peut être divisé par dix.

Comment intégrer gpt-image-2 dans vos workflows

Accéder au modèle est la partie facile. Bien l'intégrer dans un processus métier demande un peu plus de méthode.

Via ChatGPT en direct

Tous les utilisateurs ChatGPT Plus, Team et Enterprise ont accès à gpt-image-2 depuis le 21 avril, via la même interface que DALL-E 3 auparavant. Pour un usage ad hoc (un visuel de temps en temps), c'est la solution la plus simple, sans développement.

Via API + automatisation n8n

Pour industrialiser, l'API gpt-image-2 s'intègre naturellement dans des workflows n8n, Zapier ou Make. Un cas typique : une nouvelle fiche produit arrive dans PIM, un agent IA rédige le descriptif, gpt-image-2 génère les 5 visuels d'ambiance, le tout est pushé dans Shopify. Temps de traitement : moins de 3 minutes par produit, contre 2 heures en manuel.

C'est exactement le type d'automatisation sur lequel nous travaillons régulièrement pour nos clients, en connectant gpt-image-2 à leurs outils existants (CMS, PIM, CRM) via des agents sur-mesure.

Notre avis chez RedArrow

gpt-image-2 n'est pas une simple itération. C'est le premier modèle image qui rejoint le niveau de fiabilité éditoriale que l'on attendait des modèles textuels depuis GPT-4. La phase de reasoning change le rapport au prompt : on ne doit plus tenter 10 variations pour obtenir un visuel correct, le modèle fait le travail de composition à notre place.

Pour les PME et ETI françaises, le moment est particulièrement intéressant. D'un côté, les coûts de production visuelle baissent drastiquement (on parle de division par 20 à 50 selon les cas d'usage). De l'autre, la qualité atteint un niveau où le rendu passe la barre du "indiscernable à l'œil" pour 80 % des usages marketing courants. Les entreprises qui industrialisent leur chaîne de création visuelle dès maintenant prendront une avance difficile à rattraper sur leur concurrence qui reste en production manuelle.

Reste un point de vigilance : la question de la souveraineté. gpt-image-2 reste un modèle américain hébergé aux États-Unis. Pour des cas sensibles (finance, santé, secteur public), il faudra continuer à regarder du côté des alternatives européennes, comme le souligne le dernier plan en 22 mesures de Mistral pour la souveraineté IA européenne. Chez RedArrow, nous intégrons gpt-image-2 dans les workflows où il apporte une valeur claire, et nous restons pragmatiques sur le choix du modèle en fonction du contexte client. Si vous voulez évaluer l'intérêt concret de gpt-image-2 sur votre chaîne de production visuelle, nos audits IA pour PME et ETI incluent désormais une revue de ce type de cas d'usage.

FAQ

gpt-image-2 est-il disponible en France ?

Oui, gpt-image-2 est accessible depuis le 21 avril 2026 en France via ChatGPT Plus, Team et Enterprise, ainsi que via l'API OpenAI. Les conditions d'usage et la latence sont les mêmes que pour DALL-E 3 auparavant.

Combien coûte une image générée avec gpt-image-2 ?

Via l'API, le coût par image oscille entre 0,04 et 0,08 dollar selon la résolution et la complexité du prompt. Via ChatGPT Plus à 20 dollars par mois, la génération est incluse dans la limite d'usage standard, ce qui reste la meilleure option pour les équipes générant quelques dizaines de visuels par mois.

gpt-image-2 remplace-t-il un graphiste ?

Non. gpt-image-2 remplace une grande partie de la production de visuels récurrents et standardisés (bannières, vignettes, posts sociaux, illustrations d'articles). Il ne remplace ni la direction artistique, ni les supports premium, ni la conception identitaire. Pour un projet de marque ou un support à fort enjeu, le graphiste reste incontournable.

Conclusion

gpt-image-2 franchit un seuil qualitatif qui rend la génération d'image IA utilisable en production pour la majorité des cas d'usage marketing et e-commerce. La phase de reasoning, le rendu texte multilingue et la continuité de personnage sont des features attendues depuis longtemps. Les entreprises qui sauront intégrer ce modèle dans des workflows automatisés, plutôt que de l'utiliser en usage manuel ponctuel, capteront l'essentiel de la valeur. Si vous voulez cadrer rapidement un cas d'usage concret autour de gpt-image-2 pour votre entreprise, prenez rendez-vous pour un audit et nous vous livrons une feuille de route en 30 minutes.

Sources :